视频聚合搜索 - 壹搜网为您找到"

Pytorch 教程 github

"相关结果...chatGLM本地部署的AI二次元老婆,拒绝魔法,示例源码详细教程分享~

本期视频要分享的是,使用开源语言模型chatGLM,进行本地部署,并使用api,集成到AI二次元纸片人老婆项目的示例教程。最近因为chatpgt的api key试用费用没有了,所以就趁着这个机会就把chatGLM集成到我的项目里了,这样就不怕任何魔法的问题了。相关资料的传送门: 1、AI二次元小姐姐源码-chatglm版,在我的代码仓库里找到名称带有chatGLM标识的工程包就可以了: https://gitee.com/DammonSpace/chat-gptaigirl-friend-sample 2、chatGLM官方项目地址: https://github.com/THUDM/ChatGLM-6B 3、量化模型chatglm-6b-int4下载地址: https://huggingface.co/THUDM/chatglm-6b-int4 --- 我在部署chatglm时使用到的一些指令和资源地址: ①查询自己的显卡类型,以及支持的最高cuda版本:cmd窗口输入:Nvidia-smi ②查询自己已安装的cuda版本:cmd窗口输入:nvcc -V ③Torch版本地址:https://download.pytorch.org/whl/torch_stable.html

www.bilibili.com

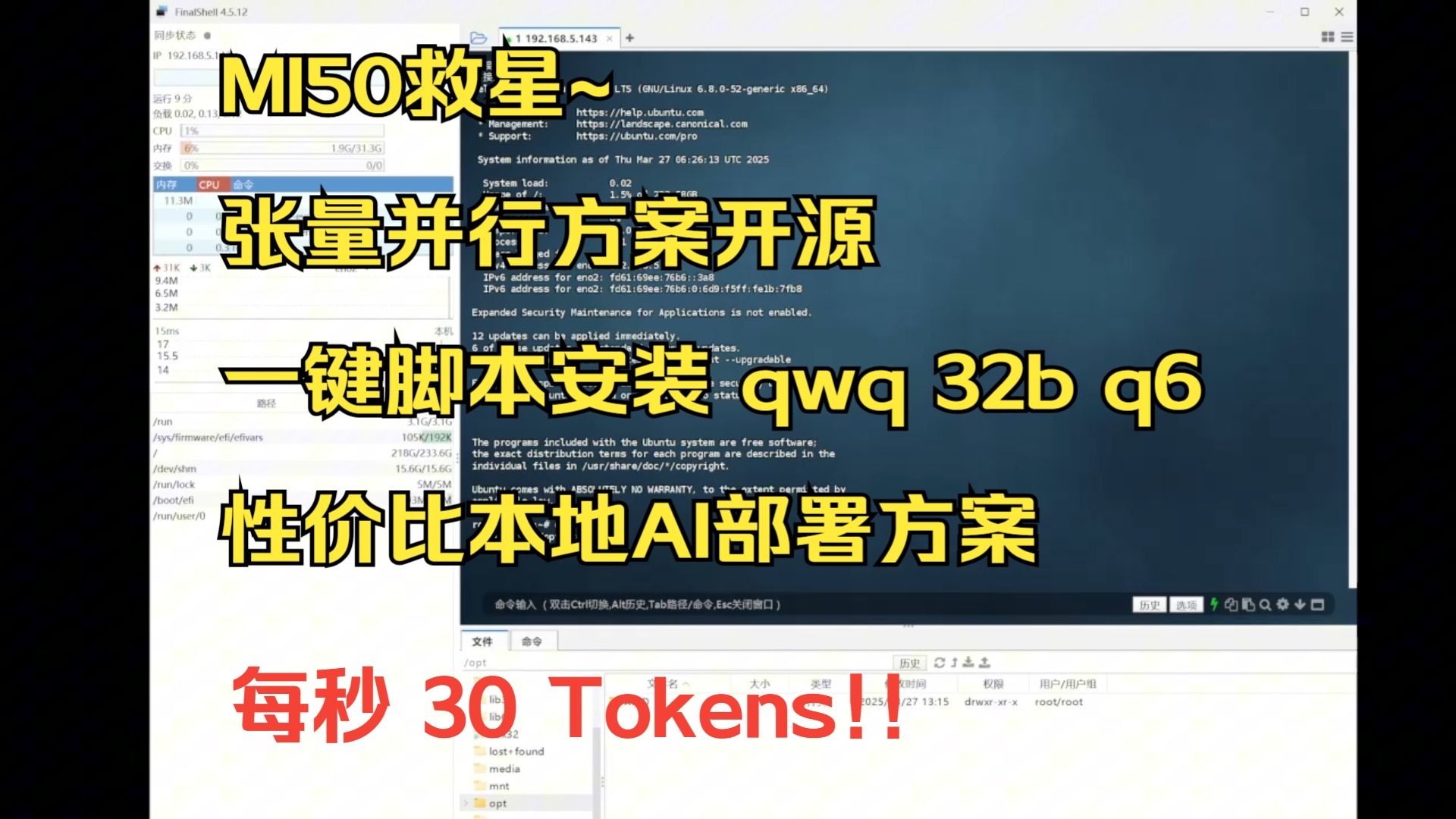

本地AI部署(MI50)张量并行方案教程 开源 QWQ32B Deepseek VLLM

2025.04.01: 一键执行:curl -L https://vllm.9700001.xyz/install.sh -o install.sh chmod +x install.sh bash install.sh 使用一键执行无需下载任何文件 修复了之前的一些问题,工作繁忙没有测试是否完全解决, 无需像之前下载文件解压等, 私信有点多,如果还是出现一些问题可以尝试源作者方案,编译源码与方法参考:https://github.com/Said-Akbar/triton-gcn5 2025.03.27: gitee下载地址: https://gitee.com/laugh-gitee/vllm-rocm github: https://github.com/Said-Akbar/vllm-rocm 安装推理框架前,请先保证目录硬盘大于200G 一键安装中途会要求重启一次,按照说明操作即可 张量并行需要使用双数卡,也就是2,4,6,8 张卡才能张量并行! 建议使用全新的ubuntu22.04系统进行安装、 进入 installsh 所在目录 进行安装 安装命令:chmod +x install.sh bash install.sh 十分之简单, 轮椅操作。 (上传文件,进入目录,安装命令一键安装,启动模型,完事) 4卡接口启动命令可以参考:ROCM_PATH=/opt/rocm PYTHONPATH=/opt/AMD/triton/python HIP_VISIBLE_DEVICES=0,1,2,3 TORCH_BLAS_PREFER_HIPBLASLT=0 PYTORCH_ROCM_ARCH=gfx906 vllm serve /opt/qwq-32b-q8.gguf --port 8001 --api_key 123456 --tensor-parallel-size 4 --quantization awq --dtype float16 --block-size 32 --max-num-seqs 64 --max-model-len 32768 其余的参数命令可以参考vllm官方文档

www.bilibili.com

Pytorch图像分类部署-ONNX Runtime安卓手机APP

【同济子豪兄】两天搞定图像分类毕业设计 代码教程:https://github.com/TommyZihao/Train_Custom_Dataset Github代码仓库:https://github.com/microsoft/onnxruntime-inference-examples Android Studio下载:https://developer.android.com/studio 前面的视频中,我们已构建了自己的30类图像分类数据集,用Pytorch迁移学习训练得到自己的图像分类模型

www.bilibili.com

高达GitHub54.7k的Ollama!快速本地部署使用开源大语言模型!推荐所有...

W 白嫖视频资料+100G入门到进阶AI资源包+论文指导发刊+kaggle带队拿牌+技术问题答疑 关注微信公众号:AI技术星球 发送211 领取 资料包:1、超详细AI学习路线 2、OpenCV、Pytorch、YOLO等框架教程 3、AI快速入门视频教程合集(Python基础、数学基础、NLP)附源码课件数据 4、机器学习算法+深度学习神经网络基础教程 5、人工智能必看书籍(花书、西瓜书、蜥蜴书等) 6、上千篇CVPR、ICCV顶会论文 7、SCI论文攻略及润色

www.bilibili.com