视频聚合搜索 - 壹搜网为您找到"

GitHub dataset

"相关结果VIODE - A Simulated Dataset to Address the Challenges of VIO in ...

https://youtu.be/LlFTyQf_dlo?list=PL5A4UvK5ORw4j63vvyZ3q0nqfFrJ-UG2B 对于主流的视觉惯性里程计(VIO)算法来说,城市地区等动态环境仍然具有挑战性。现有数据集通常无法捕捉这些环境的动态特性,因此难以定量评估现有 VIO 方法的鲁棒性。为了解决这个问题,我们提出了三个贡献:首先,我们提供了 VIODE 基准,这是一个从模拟无人机记录的新数据集,可以在具有挑战性的动态环境中导航。 VIODE 数据集的独特之处在于将移动对象系统地引入场景中。它包括三个环境,每个环境都有四个动态级别,可逐步添加移动对象。该数据集包含同步的立体图像和 IMU 数据,以及真实轨迹和实例分割掩码。其次,我们在 VIODE 数据集上比较了最先进的 VIO 算法,并表明它们在高度动态的场景中表现出显着的性能下降。第三,我们提出了一个依赖语义信息的视觉定位算法的简单扩展。我们的结果表明,场景语义是减轻动态对象对 VIO 算法的不利影响的有效方法。最后,我们在 https://github.com/kminoda/VIODE 上公开了 VIODE 数据集。 Title: VIODE: A Simulated Dataset to Address the Challenges of Visual-Inertial Odometry in Dynamic Environments Authors: Koji Minoda, Fabian Schilling, Valentin Wüest, Dario Floreano, Takehisa Yairi Publication: IEEE Robotics and Automation Letters (RA-L) Project website: https://github.com/kminoda/VIODE IEEEXplore: https://ieeexplore.ieee.org/document/. ArXiv: https://arxiv.org/abs/2102.05965

www.bilibili.com

In the GitHub repository you will find a dataset of the distrib... | Filo

Solution For In the GitHub repository you will find a dataset of the distribution of citations of scientific papers. Use SMC-ABC to fit a g-and-k dist

askfilo.com

2022年秋 第十一次DevOps论文研讨班:基于深度学习的小数据集环境...

华东师范大学 数据科学与工程学院 水杉在线平台 2022年秋 第十一次DevOps论文研讨班 2022年12月6日 主题内容:基于深度学习的小数据集环境在线反馈用户需求分类 分享人:陈可璇 摘要:大量用户访问App Store/谷歌Play等应用商店和Twitter等社交媒体平台,并提供关于数字体验的反馈。这个由用户反馈组成的庞大文本语料库有潜力挖掘用户对产品和服务的意见的详细见解。现已提出了各种各样的工具,它们使用自然语言处理(NLP)和传统的基于机器学习(ML)的模型作为在用户反馈中识别需求的低成本机制。然而,由于生成大量无偏标签数据集的成本和普遍的低效率等因素,它们在不可见数据的分类精度上存在不足。最近,Van Vliet等人通过传统的众包从用户评论中提取和分类需求,实现了最先进的结果。基于他们的参考分类任务和结果,我们成功开发并验证了一个深度学习支持的人工智能管道,实现了对用户反馈分析的标准任务的最先进的平均分类准确率高达87%。这种方法包括一个基于bert的序列分类器,即使在极少量的数据集环境中也被证明是有效的。此外,我们的方法大大减少了评估的时间和成本,并提高了使用传统的基于ML-/nlp-的技术实现的准确性度量。 整体DevOps论文研讨班日程介绍:https://github.com/OpenEduTech/EduTechResearch/blob/main/agenda/%F0%9F%8D%812022-2023-Autumn-Term-DevOps-Seminar.md

www.bilibili.com

[LLMs 实践] 10 预训练语料,mapping & streaming(load_dataset)

本期 code: https://github.com/chunhuizhang/personal_chatgpt/blob/main/tutorials/pretrain_corpus_%E5%A4%A7%E6%A8%A1%E5%9E%8B%E9%A2%84%E8%AE%AD%E7%BB%83%E8%AF%AD%E6%96%99.ipynb https://github.com/chunhuizhang/bert_t5_gpt/blob/main/tutorials/dataset_dataloader.ipynb

www.bilibili.com

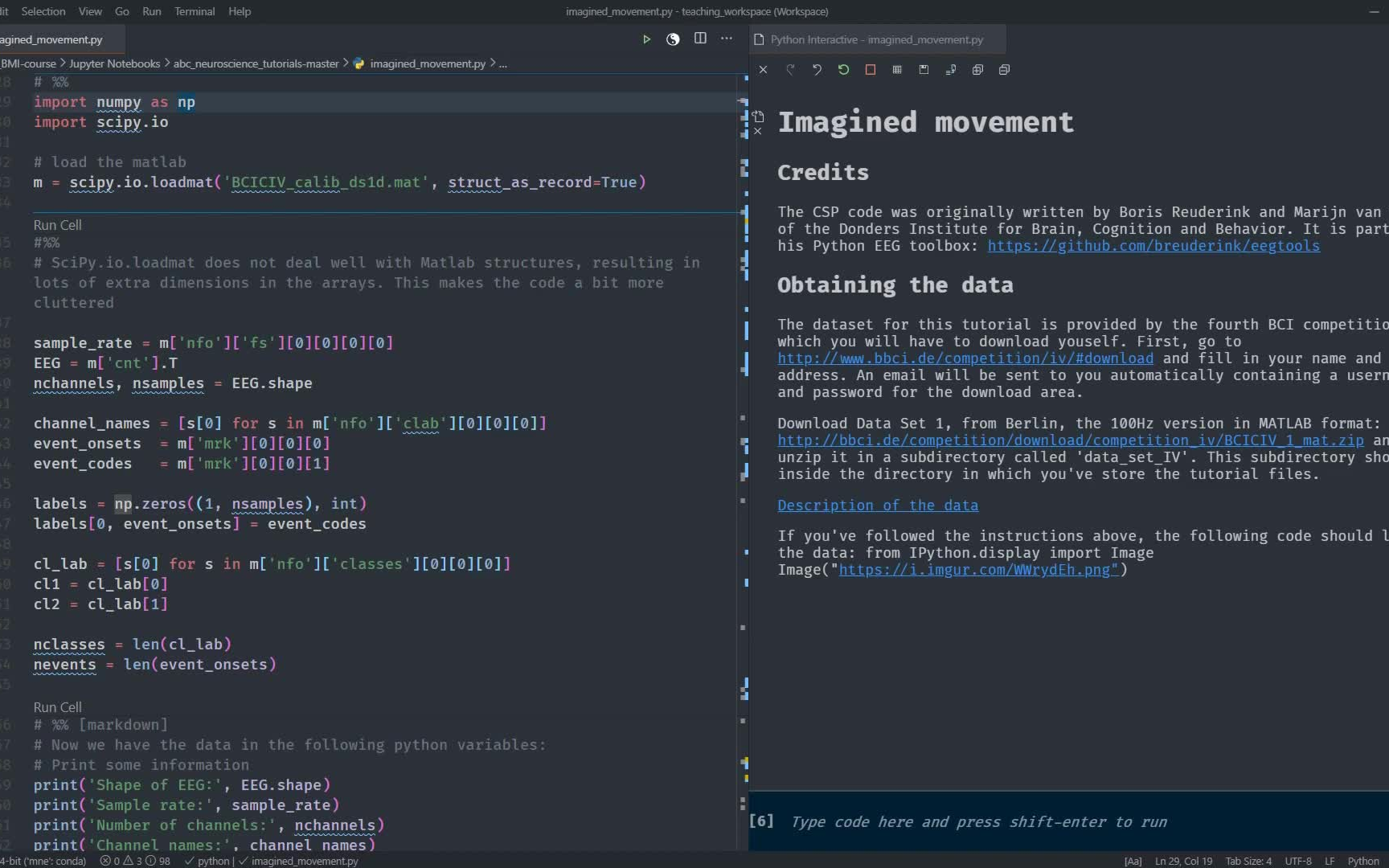

【cc字幕】EEG想象运动数据集(BCI competition IV)分析与分类

https://youtu.be/EAQcu6DLAS0 竞赛网址: 代码: https://github.com/wmvanvliet/neuroscience_tutorials/tree/master/eeg-bci

www.bilibili.com

一次讲清VPN原理、用法到配置,网络工程师必学技术,可不要只知道翻墙啦!

2026年全栈-网络工程师从零基础入门到进阶必学教程! 网工入门丨数据通信丨路由交换丨DeepSeek辅导学习 持续更新中... ... 如有需要视频配置笔记可在评论区留言!!!

www.bilibili.com