视频聚合搜索 - 壹搜网为您找到"

强化学习讲解

"相关结果CS231n 14.深度增强学习 @雷锋字幕组

https://www.youtube.com/playlist?list=PL3FW7Lu3i5JvHM8ljYj-zLfQRF3EO8sYv CS231n 14.深度增强学习 @雷锋字幕组

www.bilibili.com

拼音卡片全盒230张,学习拼音这一套就够了,双面内容加深记忆,拓展内容强化训练更易理解

www.iqiyi.com25.巴普洛夫的条件反射实验

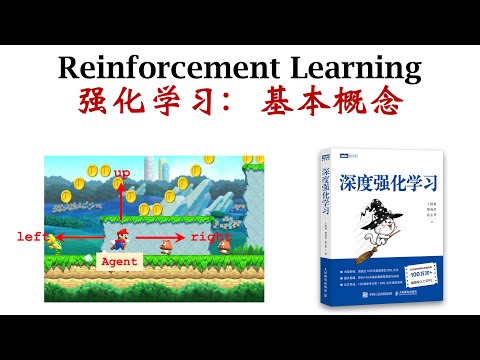

强化学习,又称再励学习、评价学习或增强学习,是机器学习的范式和方法论之一,用于描述和解决智能体在与环境的交互过程中通过学习策略以达成回报最大化或实现特定目标的问题

www.bilibili.com

大模型进化论15:强化学习PPO | OpenAI 的天才设计 | 大模型强化学习的核心引擎

现在的顶级大模型(从 GPT-4 到 Claude)几乎都在使用强化学习,而其核心算法往往都绕不开 PPO (Proximal Policy Optimization)。 这个算法由 OpenAI 在 2017 年提出。虽然当时大模型还没出世,但 OpenAI 对强化学习的执着,最终在这个算法上展现了“天才般的设计”。为什么 PPO 成了业界标配?它又是如何解决传统强化学习中“数据利用率低”和“训练不稳定”这两大难题的? 在这个视频中,我们将抽丝剥茧,带你彻底理解 PPO 的底层逻辑: 📌 你将了解到:

www.bilibili.com